Dependiendo de la teoría de inteligencia a la que se suscriba, lograr una IA de “nivel humano” requerirá un sistema que pueda aprovechar múltiples modalidades, por ejemplo, sonido, visión y texto, para razonar sobre el mundo. Por ejemplo, cuando se muestra una imagen de un camión volcado y una patrulla de policía en una autopista nevada, una IA de nivel humano podría inferir que las condiciones peligrosas de la carretera causaron un accidente. O, corriendo en un robot, cuando se les pide que tomen una lata de refresco del refrigerador, navegan entre personas, muebles y mascotas para recuperar la lata y colocarla al alcance del solicitante.

La IA actual se queda corta. Pero una nueva investigación muestra señales de un progreso alentador, desde robots que pueden descifrar pasos para satisfacer órdenes básicas (p. ej., “coge una botella de agua”) hasta sistemas de producción de texto que aprenden de las explicaciones. En esta edición renovada de Deep Science, nuestra serie semanal sobre los últimos desarrollos en IA y el campo científico más amplio, cubrimos el trabajo de DeepMind, Google y OpenAI que avanza hacia sistemas que pueden, si no entender perfectamente el mundo. resolver tareas limitadas como generar imágenes con una robustez impresionante.

Laboratorio de investigación de IA El DALL-E mejorado de OpenAI, DALL-E 2, es fácilmente el proyecto más impresionante que emerge de las profundidades de un laboratorio de investigación de IA. Como escribe mi colega Devin Coldewey, mientras que el DALL-E original demostró una destreza notable para crear imágenes que coincidieran con prácticamente cualquier mensaje (por ejemplo, “un perro con una boina”), DALL-E 2 va más allá. Las imágenes que produce son mucho más detalladas y DALL-E 2 puede reemplazar de manera inteligente un área determinada en una imagen, por ejemplo, insertando una mesa en una foto de un piso de mármol repleto de los reflejos apropiados.

Un ejemplo de los tipos de imágenes que DALL-E 2 puede generar.

DALL-E 2 recibió la mayor parte de la atención esta semana. Pero el jueves, los investigadores de Google detallaron un sistema de comprensión visual igualmente impresionante llamado Visually-Driven Prosody for Text-to-Speech (VDTTS) en una publicación publicada en el blog de IA de Google. VDTTS puede generar un discurso sincronizado con los labios y con un sonido realista dado nada más que cuadros de texto y video de la persona que habla.

El habla generada por VDTTS, aunque no es un sustituto perfecto para el diálogo grabado, sigue siendo bastante buena, con una expresividad y un ritmo convincentemente parecidos a los humanos. Google ve que algún día se usará en un estudio para reemplazar el audio original que podría haber sido grabado en condiciones ruidosas.

Por supuesto, la comprensión visual es solo un paso en el camino hacia una IA más capaz. Otro componente es la comprensión del lenguaje, que va a la zaga en muchos aspectos, incluso dejando de lado los bien documentados problemas de toxicidad y sesgo de la IA. En un claro ejemplo, un sistema de vanguardia de Google, Pathways Language Model (PaLM), memorizó el 40% de los datos que se usaron para “entrenarlo”, según un documento, lo que resultó en que PaLM plagiara texto hasta avisos de derechos de autor en fragmentos de código.

Afortunadamente, DeepMind, el laboratorio de inteligencia artificial respaldado por Alphabet, se encuentra entre los que exploran técnicas para abordar este problema. En un nuevo estudio, los investigadores de DeepMind investigan si los sistemas de lenguaje de IA, que aprenden a generar texto a partir de muchos ejemplos de texto existente (piense en libros y redes sociales), podrían beneficiarse de recibir explicaciones de esos textos. Después de anotar docenas de tareas de lenguaje (p. ej., “Responda estas preguntas identificando si la segunda oración es una paráfrasis apropiada de la primera oración metafórica”) con explicaciones (p. ej., “Los ojos de David no eran literalmente dagas, es una metáfora utilizada para implica que David estaba mirando ferozmente a Paul.”) y evaluando el rendimiento de diferentes sistemas en ellos, el equipo de DeepMind encontró que los ejemplos de hecho mejoran el rendimiento de los sistemas.

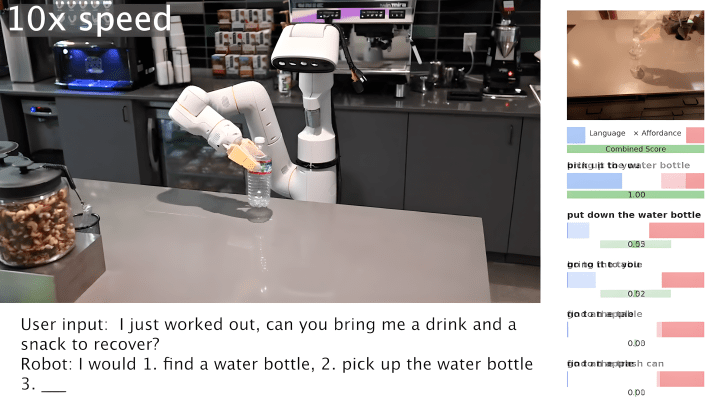

El enfoque de DeepMind, si pasa el examen dentro de la comunidad académica, algún día podría aplicarse en robótica, formando los componentes básicos de un robot que puede entender solicitudes vagas (por ejemplo, “tirar la basura”) sin instrucciones paso a paso. El nuevo proyecto de Google “Haz lo que puedo, no lo que digo” da una idea de este futuro, aunque con limitaciones significativas.

Una colaboración entre Robotics en Google y el equipo de Everyday Robotics en el laboratorio X de Alphabet, Do As I Can, Not As I Say busca condicionar un sistema de lenguaje de IA para proponer acciones “factibles” y “contextualmente apropiadas” para un robot, dado un arbitrario tarea. El robot actúa como las “manos y los ojos” del sistema de lenguaje, mientras que el sistema proporciona conocimiento semántico de alto nivel sobre la tarea; la teoría es que el sistema de lenguaje codifica una gran cantidad de conocimiento útil para el robot.

Créditos de imagen: Robótica en Google

Un sistema llamado SayCan selecciona qué habilidad debe realizar el robot en respuesta a un comando, teniendo en cuenta (1) la probabilidad de que una determinada habilidad sea útil y (2) la posibilidad de ejecutar con éxito dicha habilidad. Por ejemplo, en respuesta a alguien que dice “Derramé mi coca cola, ¿puedes traerme algo para limpiarla?”, SayCan puede indicarle al robot que busque una esponja, la recoja y se la lleve a la persona que la pidió. eso.

SayCan está limitado por el hardware de robótica: en más de una ocasión, el equipo de investigación observó que el robot que eligieron para realizar experimentos dejó caer objetos accidentalmente. Aún así, junto con DALL-E 2 y el trabajo de DeepMind en comprensión contextual, es una ilustración de cómo los sistemas de IA cuando se combinan pueden acercarnos mucho más a un Tipo Supersónicos futuro.