India, desde hace mucho tiempo diente cuando se trata de Cooptar la tecnología para persuadir al público., se ha convertido en un foco mundial en lo que respecta a cómo se utiliza y se abusa de la IA en el discurso político y, específicamente, en el proceso democrático. Las empresas de tecnología, que construyeron las herramientas en primer lugar, están viajando al país para impulsar soluciones.

A principios de este año, Andy Parsons, director senior de Adobe que supervisa su participación en la Iniciativa de Autenticidad de Contenido (CAI) intersectorial, entró en la vorágine cuando hizo un viaje a la India para visitar organizaciones de medios y tecnología en el país para promover herramientas que puedan integrarse en los flujos de trabajo de contenido para identificar y marcar contenido de IA.

“En lugar de detectar lo que es falso o manipulado, nosotros como sociedad, y esto es una preocupación internacional, deberíamos comenzar a declarar autenticidad, es decir, decir si algo es generado por IA, eso debería ser conocido por los consumidores”, dijo en una entrevista.

Parsons añadió que algunas empresas indias (que actualmente no forman parte del acuerdo de seguridad electoral de IA de Munich firmado por OpenAI, Adobe, Google y Amazon en febrero) tenían la intención de construir una alianza similar en el país.

“La legislación es algo muy complicado. Asumir que el gobierno legislará correcta y suficientemente rápidamente en cualquier jurisdicción es algo en lo que es difícil confiar. Es mejor que el gobierno adopte un enfoque muy firme y se tome su tiempo”, afirmó.

Las herramientas de detección son famosas por su inconsistencia, pero son un comienzo para solucionar algunos de los problemas, o al menos eso dice el argumento.

“El concepto ya se comprende bien”, afirmó durante su viaje a Delhi. “Lo que estoy ayudando es a concientizar que las herramientas también están listas. No es sólo una idea. Esto es algo que ya está implementado”.

Andy Parsons, director senior de Adobe. Créditos de imagen: Adobe

La CAI, que promueve estándares abiertos y libres de regalías para identificar si el contenido digital fue generado por una máquina o por un ser humano, es anterior al revuelo actual en torno a la IA generativa: se fundó en 2019 y ahora cuenta con 2500 miembros, incluidos Microsoft, Meta y Google. , The New York Times, The Wall Street Journal y la BBC.

Así como hay una industria que crece en torno al negocio de aprovechar la IA para crear medios, se está creando una más pequeña para tratar de corregir algunas de las aplicaciones más nefastas de eso.

Entonces, en febrero de 2021, Adobe dio un paso más en la creación de uno de esos estándares y cofundó la Coalición para la procedencia y autenticidad del contenido (C2PA) con ARM, BBC, Intel, Microsoft y Truepic. La coalición tiene como objetivo desarrollar un estándar abierto, que aprovecha los metadatos de imágenes, videos, texto y otros medios para resaltar su procedencia e informar a la gente sobre los orígenes del archivo, la ubicación y el momento de su generación, y si fue alterado antes de llegar a su destino. el usuario. El CAI trabaja con C2PA para promover el estándar y ponerlo a disposición de las masas.

Ahora está colaborando activamente con gobiernos como el de la India para ampliar la adopción de ese estándar para resaltar la procedencia del contenido de IA y participar con las autoridades en el desarrollo de directrices para el avance de la IA.

Adobe no tiene nada más que perder si juega un papel activo en este juego. Todavía no está adquiriendo ni construyendo grandes modelos de lenguaje propios, pero como hogar de aplicaciones como Photoshop y Lightroom, es el líder del mercado en herramientas para la comunidad creativa, por lo que no solo está creando nuevos productos como Firefly para generar Contenido de IA de forma nativa, pero está incorporando IA a productos heredados. Si el mercado se desarrolla como algunos creen, la IA será imprescindible si Adobe quiere mantenerse en la cima. Si los reguladores (o el sentido común) se salen con la suya, el futuro de Adobe bien puede depender de su éxito en garantizar que lo que vende no contribuya al desorden.

En cualquier caso, el panorama general de la India es ciertamente un desastre.

Google se centró en India como banco de pruebas sobre cómo prohibir el uso de su herramienta de inteligencia artificial generativa Gemini cuando se trata de contenido electoral; las fiestas son armar la IA crear memes con imágenes de oponentes; Meta ha creado un deepfake “línea de ayudaPara WhatsApp, tal es la popularidad de la plataforma de mensajería a la hora de difundir misivas impulsadas por IA; y en un momento en que los países parecen cada vez más alarmados por la seguridad de la IA y lo que tienen que hacer para garantizarla, tendremos que ver cuál será el impacto de que el gobierno de la India decida en marzo relajar las reglas sobre cómo se construyen los nuevos modelos de IA. , probado e implementado. En cualquier caso, ciertamente está destinado a estimular una mayor actividad de la IA.

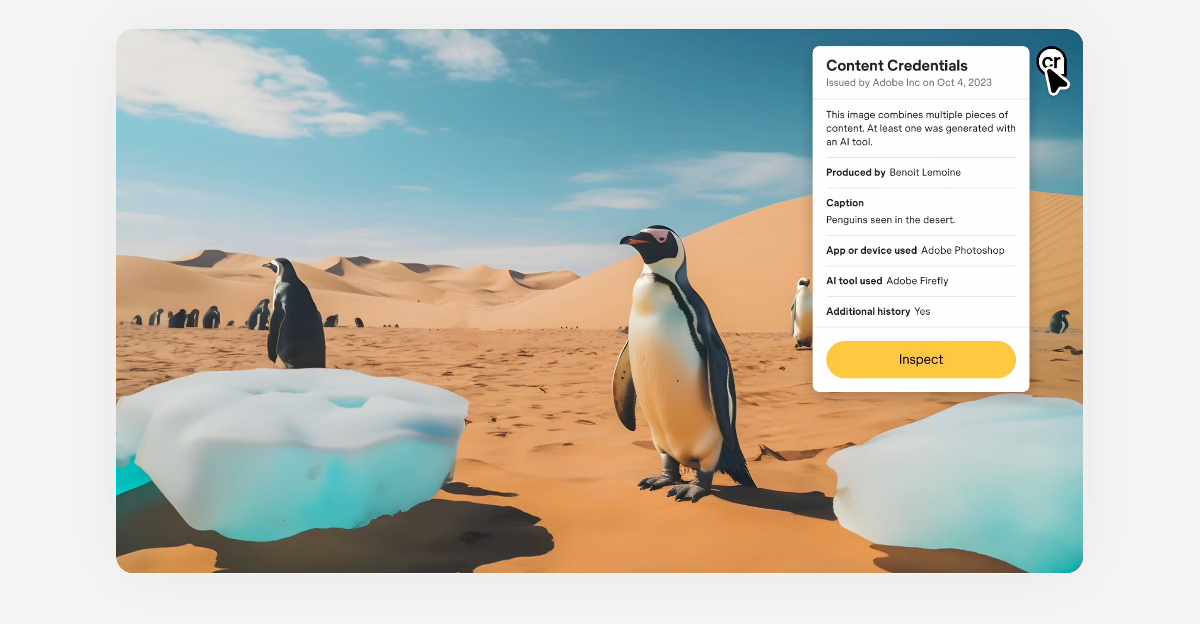

Utilizando su estándar abierto, C2PA ha desarrollado una etiqueta nutricional digital para contenidos llamada Credenciales de contenido. Los miembros de CAI están trabajando para implementar la marca de agua digital en su contenido para que los usuarios sepan su origen y si está generado por IA. Adobe tiene credenciales de contenido en todas sus herramientas creativas, incluidas Photoshop y Lightroom. También se adjunta automáticamente al contenido de IA generado por el modelo de IA Firefly de Adobe. El año pasado, Leica lanzó su cámara con Credenciales de contenido integradas, y Microsoft agregó Credenciales de contenido a todas las imágenes generadas por IA creadas con Bing Image Creator.

Créditos de imagen: Credenciales de contenido

Parsons dijo a TechCrunch que CAI está hablando con gobiernos globales en dos áreas: una es ayudar a promover el estándar como estándar internacional y la otra es adoptarlo.

“En un año electoral, es especialmente crítico para los candidatos, partidos, cargos en ejercicio y administraciones que publican material a los medios y al público todo el tiempo asegurarse de que se pueda saber si algo es divulgado por el Primer Ministro [Narendra] La oficina de Modi, en realidad es de la oficina del primer ministro Modi. Ha habido muchos incidentes en los que ese no es el caso. Por eso, entender que algo es verdaderamente auténtico para los consumidores, los verificadores de datos, las plataformas y los intermediarios es muy importante”, dijo.

La gran población de la India, su vasto idioma y su diversidad demográfica hacen que sea difícil frenar la desinformación, añadió, y un voto a favor de etiquetas simples para eliminar eso.

“Eso es un poco ‘CR’… son dos letras occidentales como la mayoría de las herramientas de Adobe, pero esto indica que hay más contexto para mostrar”, dijo.

La controversia continúa en torno a cuál podría ser el verdadero objetivo detrás de que las empresas de tecnología apoyen cualquier tipo de medida de seguridad de la IA: ¿se trata realmente de una preocupación existencial, o simplemente de sentarse a la mesa para dar la impresión de preocupación existencial, al mismo tiempo que se garantiza que sus ¿Se salvaguardan los intereses en el proceso de elaboración de normas?

“En general, no es controvertido con las empresas involucradas, y todas las empresas que firmaron el reciente acuerdo de Munich, incluida Adobe, que se unieron, abandonaron las presiones competitivas porque estas ideas son algo que todos debemos hacer”, dijo en defensa. del trabajo.